Чеклист: как выполнить техническую оптимизацию сайта

Мануалы

Один из главных аспектов поисковой оптимизации — технический SEO аудит. Это проверка и анализ параметров, которые влияют на скорость загрузки, безопасность сайта и удобство его использования в целом. Провести аудит без подключения сторонних инструментов трудоёмко и затратно по времени. В этой статье я расскажу, как не упустить важные технические параметры и провести SEO-анализ самостоятельно.

- 1. Что такое техническая оптимизация сайта

- 2. Основные аспекты технической оптимизации

- 2.1. Инструкции по сканированию и индексации

- 2.2. Карта сайта

- 2.3. Коды ответов сервера

- 2.4. Редиректы

- 2.5. Проверка на битые ссылки

- 2.6. Поиск дублей страниц

- 2.7. Скорость загрузки сайта

- 2.8. Структура сайта

- 2.9. Внутренняя перелинковка

- 2.10. Протоколы HTTP / HTTPS

- 2.11. ЧПУ

- 2.12. Глубина и вложенность URL

- 2.13. Оптимизация для мобильных устройств

- 2.14. Канонические страницы

- 2.15. Оптимизация контента

- 2.16. Оптимизация изображений

1. Что такое техническая оптимизация сайта

Технический анализ сайта в SEO включает параметры, которые не видны посетителю сайта. В то же время эти параметры напрямую влияют на удобство навигации, качество индексации, скорость отображения контента, доступ ко вложенным разделам и пр. Определение и исправление технических ошибок способствуют улучшению работоспособности всего сайта и взаимодействия пользователей с ним.

Проводить техническую оптимизацию сайтанеобходимо на всех этапах развития и существования сайта:

- при запуске ресурса;

- при переезде на новый домен;

- при редизайне или изменении структуры.

Для выполнения технического SEO-аудита потребуются сервисы и инструменты, которые специализируются на поиске разных типов ошибок. Дальше SEO-специалист или вебмастер принимается за исправление этих ошибок. Для выявления основных технических неисправностей в этом посте я буду использовать SEO-краулер Netpeak Spider.

2. Основные аспекты технической оптимизации

Для проведения качественного анализа стоит брать во внимание ключевые элементы технической SEO-оптимизации. Далее я расскажу, что необходимо оптимизировать и регулярно проверять.

2.1. Инструкции по сканированию и индексации

Регулярно проверяйте, как поисковые роботы индексируют страницы сайта. Для этого необходимо правильно указывать директивы в файле robots.txt, а также обновлять XML Sitemap. Посмотреть страницы, которые находятся в индексе поисковых систем можно в сервисах для вебмастеров.

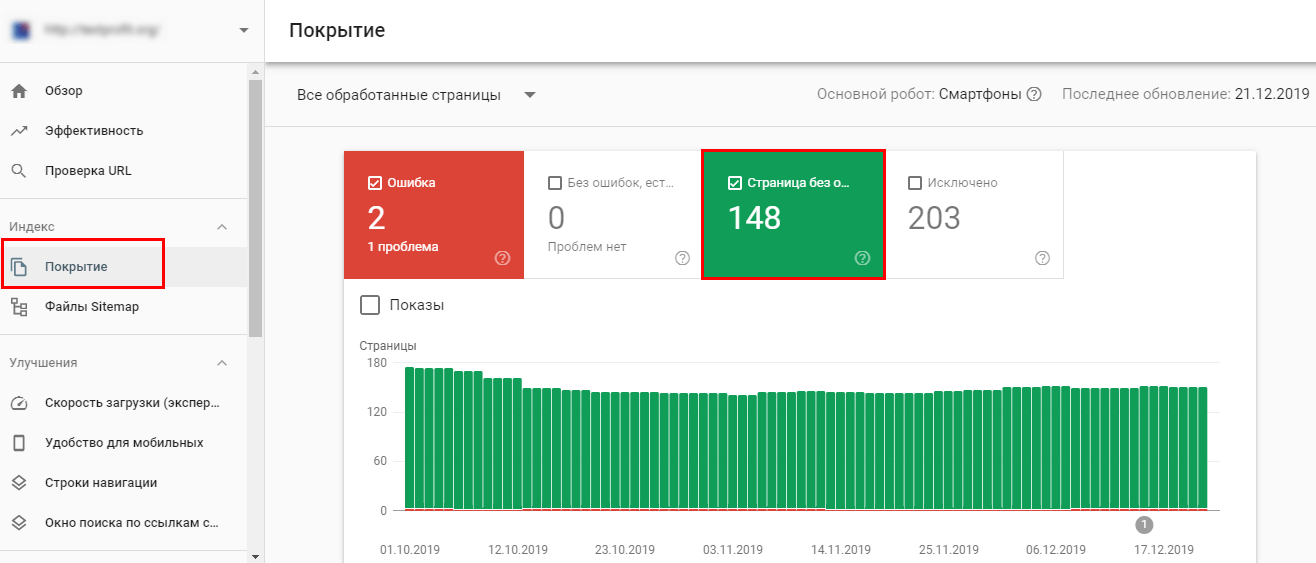

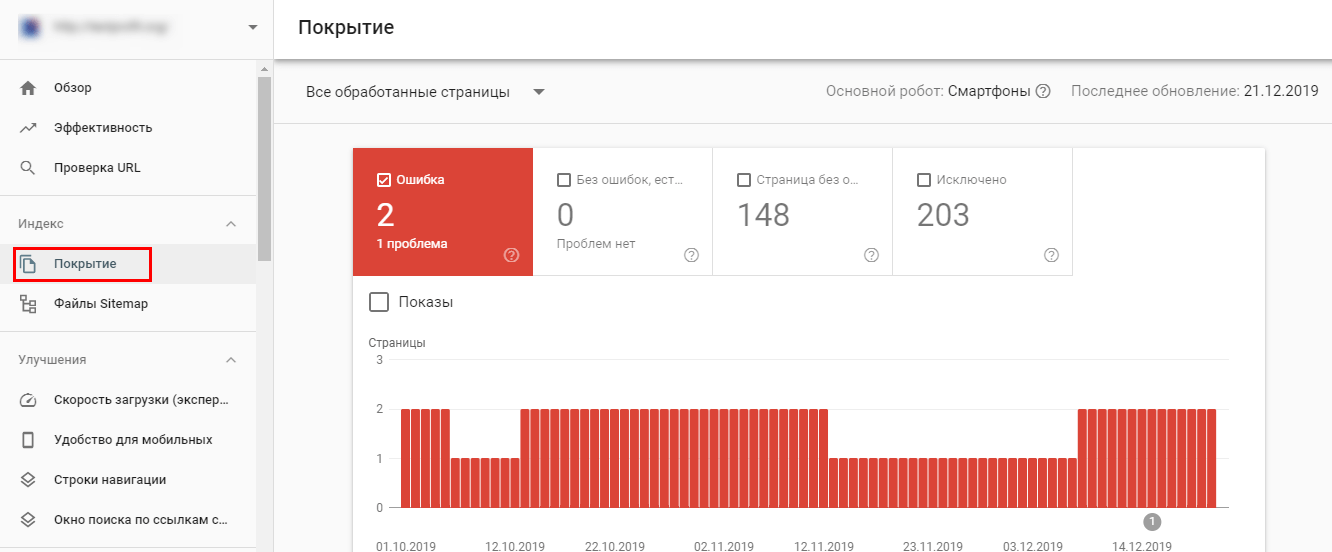

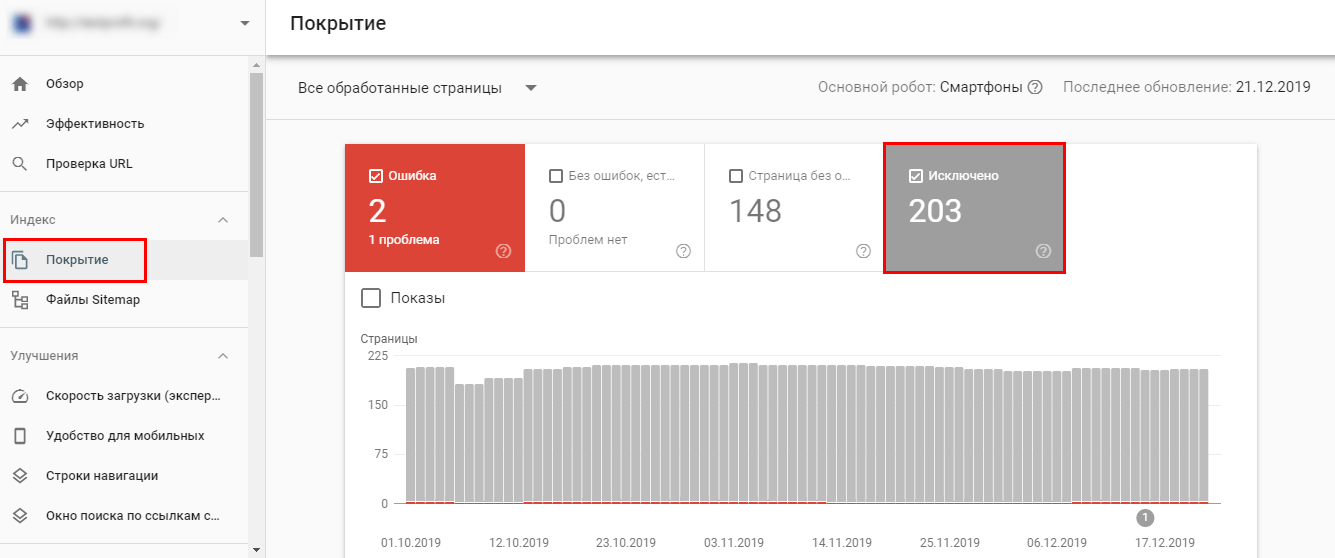

В инструменте для веб-мастеров от Google — Search Console информация об индексируемых страницах просматривается в разделе «Покрытие».

Здесь можно проверить:

- среднюю позицию страниц сайта в поисковой выдаче и показатель кликабельности CTR;

- ошибки индексации;

- наличие Sitemap и доступ к карте;

- скорость загрузки страниц;

- удобство для мобильных пользователей;

- наложенные ручные санкции.

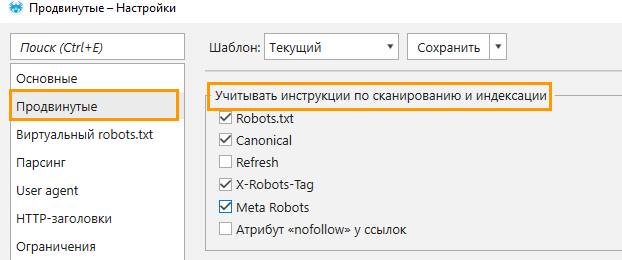

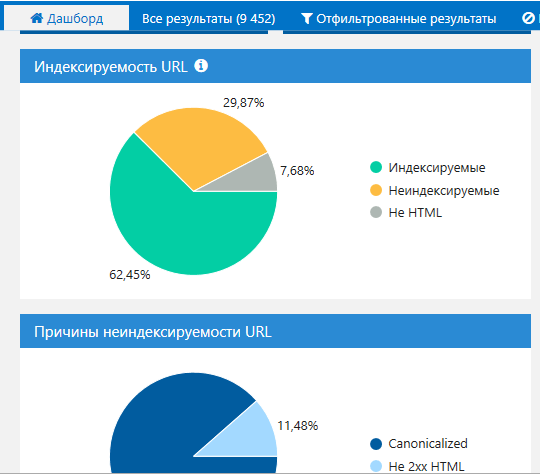

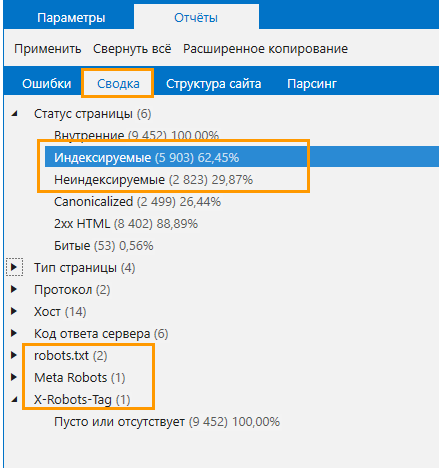

Также проверить инструкции по индексации можно в Netpeak Spider:

- Перейдите в «Настройки» → «Продвинутые» и отметьте чекбоксы в разделе «Учитывать инструкции по сканированию и индексации».

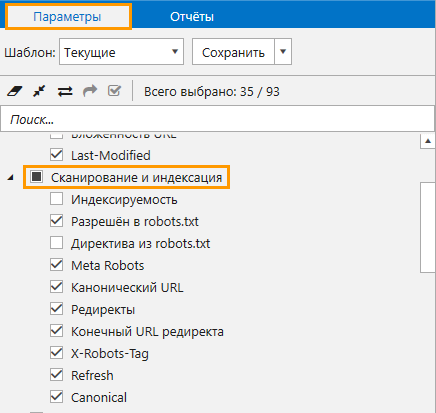

- Отметьте аналогичные параметры на боковой панели.

- Нажмите на «Старт», чтобы запустить сканирование.

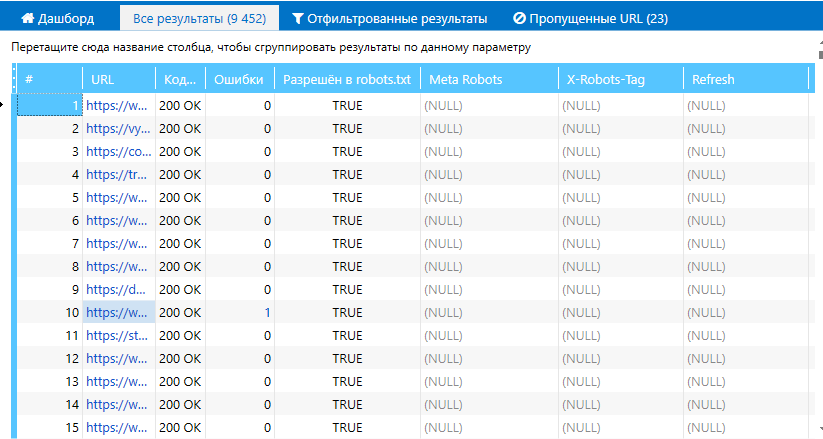

- По итогу ознакомьтесь с результатами:

- в основной таблице:

- на Дашборде:

- в разделе «Сводка»:

- в основной таблице:

Чтобы начать пользоваться Netpeak Spider, просто зарегистрируйтесь, скачайте и установите программу — и вперёд! 😉

2.2. Карта сайта

XML Sitemap создаётся для ускорения индексации страниц и способствует эффективному продвижению сайта в поиске. Карта сайта содержит URL-адреса, которые необходимо добавить в индекс поисковых систем. Составить Sitemap можно вручную, сгенерировать или скачать при помощи специальных сервисов, плагинов CMS. Например, создать карту сайта можно через инструмент SiteMap Generator или Netpeak Spider.

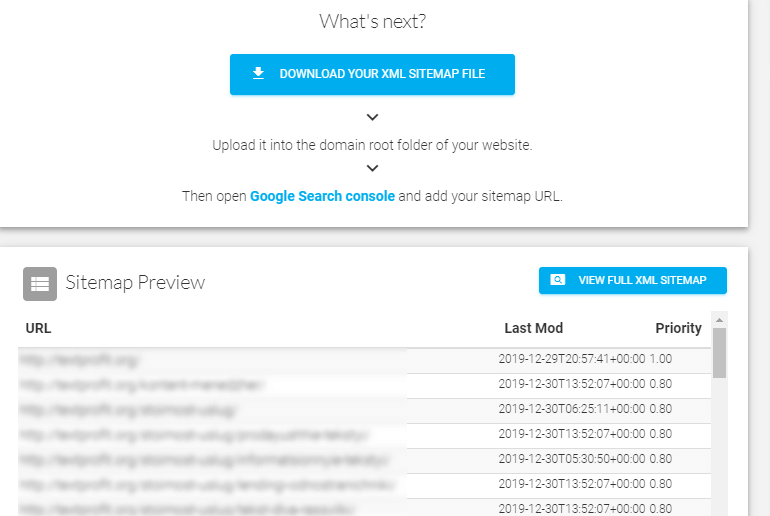

В Sitemap Generator нужно ввести адрес сайта и запустить генерацию. Через некоторое время доступна для просмотра и скачивания готовая карта сайта.

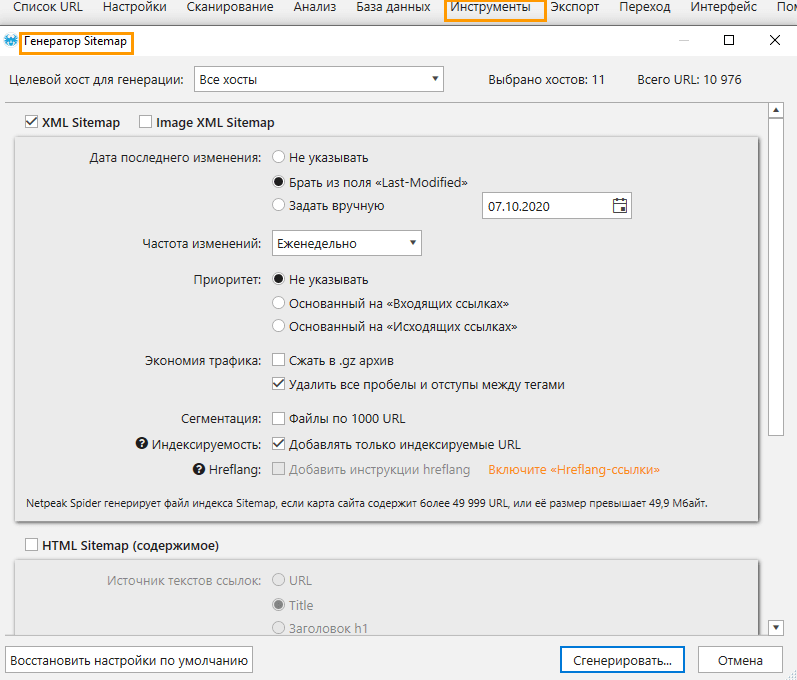

В Netpeak Spider для создания карты необходимо просканировать сайт с учётом инструкций по индексации и сканированию, а по завершении анализа перейти в инструмент «Генератор Sitemap».

Проверить созданный файл можно в соответствующих разделах панели вебмастеров Google или в программе Netpeak Spider с помощью инструмента «Валидатор XML Sitemap» → подробнее мы рассказали в посте «Что такое XML Sitemap, как его создать и проверить в Netpeak Spider». Такую проверку нужно проводить при каждом техническом аудите с целью определения невалидных адресов, а также после обновления структуры сайта.

2.3. Коды ответов сервера

Код ответа сервера — это трёхзначное число и фраза на английском языке, которая помогает понять браузеру, как ресурс отреагировал на запрос. Сервер возвращает код 200 ОК для существующих активных страниц, 404 — для несуществующих, 301 и 302 — для редиректов, 500 — при внутренней ошибке сервера. Но так происходит не всегда. В рамках технического аудита нужно проверять правильность отображения кодов после обращения к серверу. Например, можно ввести в адресную строку несуществующую страницу и посмотреть, отображается ли 404 код.

Неправильное отображение кода сбивает с толку посетителей сайта и способствует некорректной индексации страниц. Важно, чтобы страницы выдавали правильный код при ответе сервера.

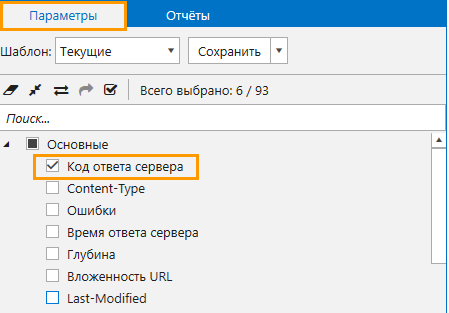

Чтобы быстро проверить коды ответа сервера на всём сайте, запустите проверку в Netpeak Spider, предварительно включив один пункт в параметрах → «Код ответа сервера».

2.4. Редиректы

Неправильная настройка редиректов приводит к понижению позиций и ухудшению поведенческих факторов. Иногда редиректы не проставлены там, где они должны быть, либо на сайте есть перенаправления, которые раздражают посетителей и не дают поисковику правильно проиндексировать сайт. Рассмотрим ситуации, при которых уместно использовать редиректы:

- переезд сайта на новый домен;

- обновление протокола с http на https;

- наличие склеенных доменов;

- перенаправление на главное зеркало;

- создание канонических страниц;

- наличие дублей страниц, если их невозможно удалить;

- перенаправление на мобильную версию;

- удаление страницы или раздела.

Чтобы выполнить проверку редиректов и найти ошибки, связанные с переадресацией, используйте Netpeak Spider. Для этого:

- Перед сканированием на боковой панели программы отметьте пункт «Код ответа сервера».

- Запустите сканирование

- По окончании вы увидите коды ответа сервера всех просканированных страниц, в том числе 3хх коды, которые говорят о перенаправлении.

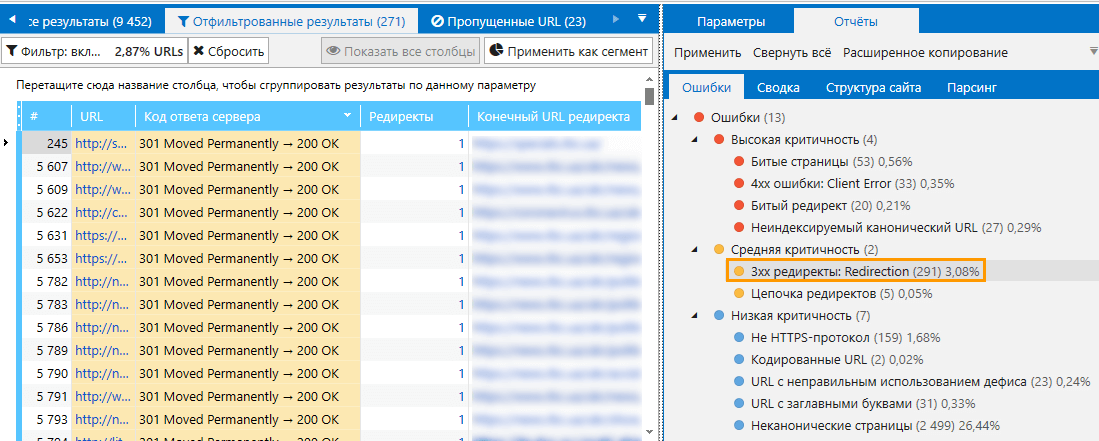

- Чтобы отфильтровать страницы с редиректами, кликните по ошибке средней критичности «3хх редиректы: Redirection». В таблице вы увидите исходный и конечный URL.

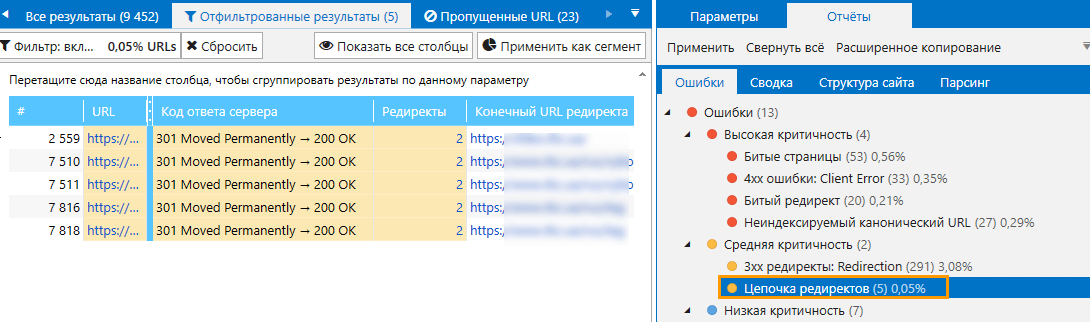

- Если Spider обнаружил цепочку редиректов, вы также увидите эту ошибку в отчёте.

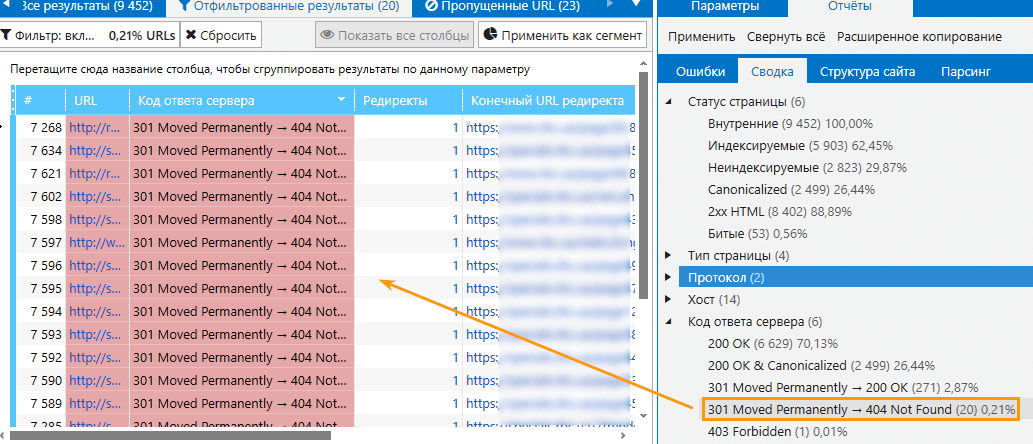

- В разделе «Сводка» вы можете посмотреть коды ответа серверов страниц, на которые ведут редиректы. Если вы обнаружили редиректы, которые ведут на страницы 404, это необходимо немедленно исправить.

2.5. Проверка на битые ссылки

Битые ссылки — это ссылки, которые ведут на несуществующие страницы. Большое количество битых ссылок на сайте влечёт за собой падение позиций и недоверие к сайту со стороны поисковых систем. Обнаружить такие URL помогут Google Search Console, Netpeak Spider и других сервисы и инструменты.

В Google Search Console неактивные ссылки доступны в разделе «Покрытие» — «Ошибки».

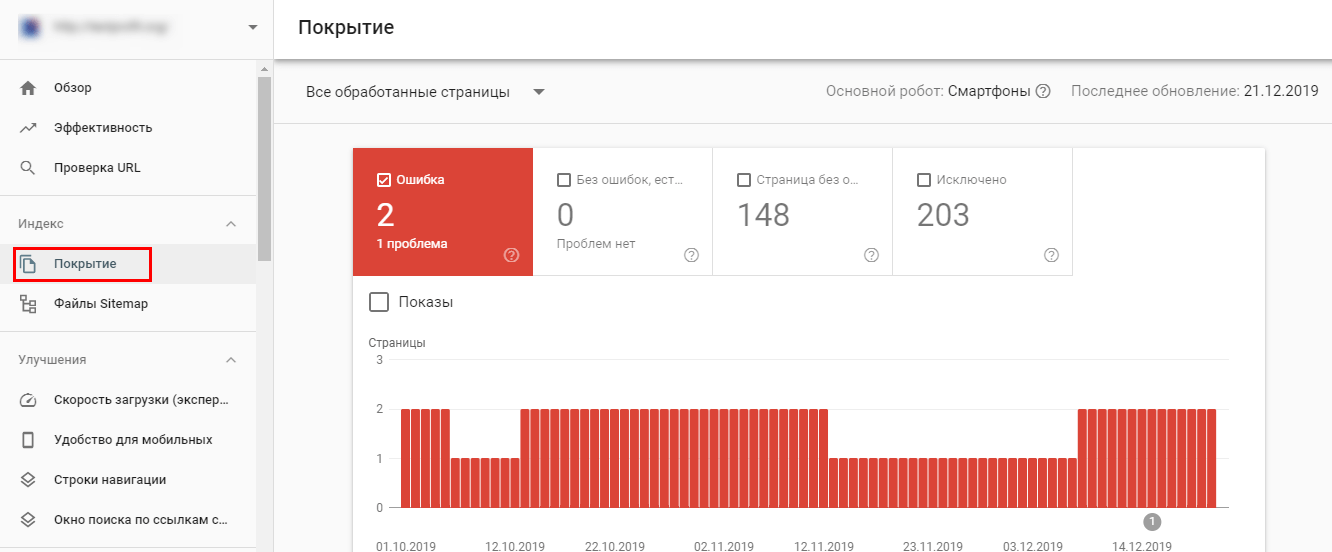

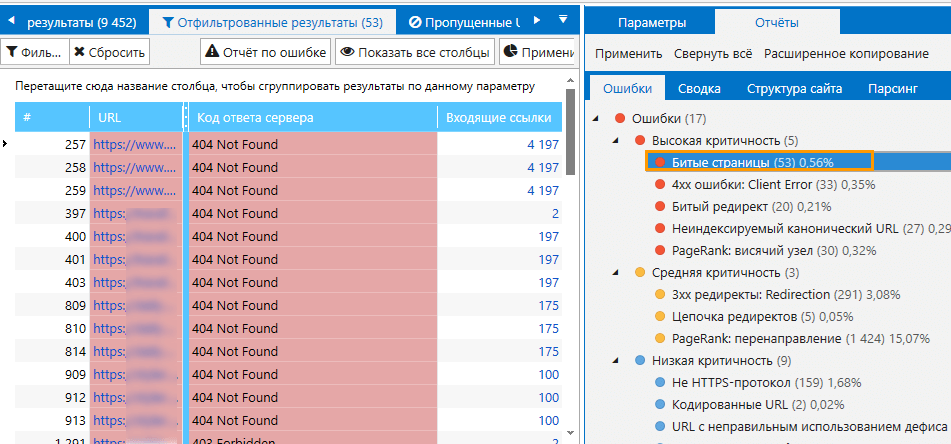

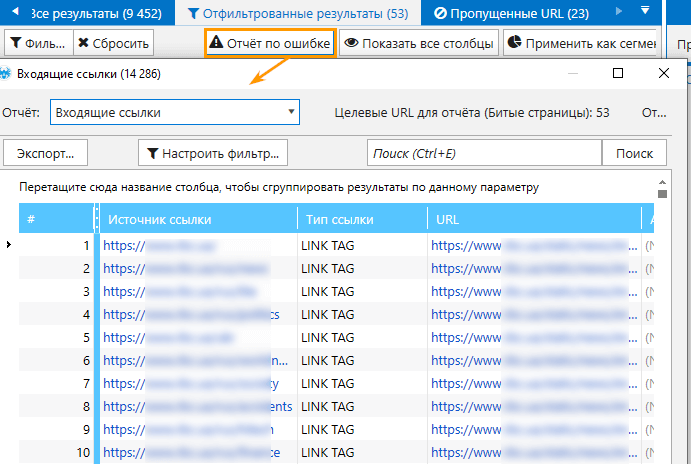

Чтобы найти битые страницы с помощью Netpeak Spider, необходимо:

- В параметрах сканирования выбрать «Код ответа сервера».

- В основных настройках поставить галочку напротив пункта «Сканировать внешние ссылки».

- После окончания краулинга отфильтровать все битые страницы кликом на ошибку на боковой панели с соответствующим названием.

- Открыть отчёт по ошибке, чтобы ознакомиться с URL, которые ведут на несуществующие страницы.

2.6. Поиск дублей страниц

Дубликаты — это страницы с полным или частичным совпадением контента. Если поисковый робот обнаружит дубликаты, он может проиндексировать не важные для продвижения страницы, в результате понизит позиции в выдаче. Основные причины появления дублей:

- их автоматически создает CMS сайта;

- не указано главное зеркало;

- индексируются ссылки из корзины с товарами;

- одна страница доступна из разных разделов сайта под разными URL;

- индексируются результаты поиска, фильтров.

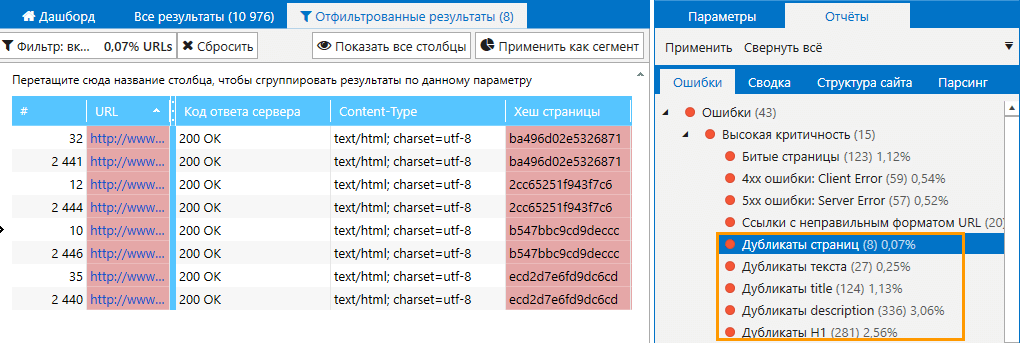

Обнаружить дубли страниц можно в панели веб-мастеров Google либо при помощи онлайн-инструментов.

В Google Search Console дубликаты доступны в разделе «Покрытие» — «Исключено».

Для поиска дубликатов в Netpeak Spider выполните следующие шаги:

- На вкладке настроек «Продвинутые» отметьте все пункты из раздела «Учитывать инструкции по индексации» → чтобы программа показала дубликаты на индексируемых страницах. Если в результатах сканирования вы увидите скрытые дубли, это может свидетельствовать о проблемах с настройками инструкций или атрибутов.

- После сканирования сайта изучите отчёт по ошибкам, и если среди них будут дубликаты, их необходимо устранить — удалить, настроить редиректы либо канонические страницы

2.7. Скорость загрузки сайта

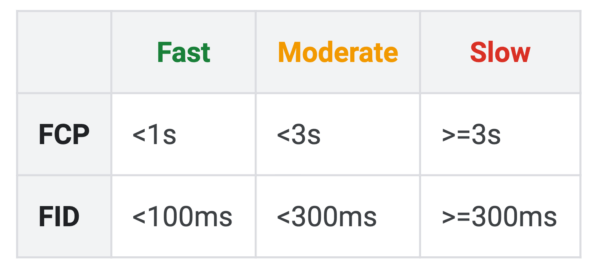

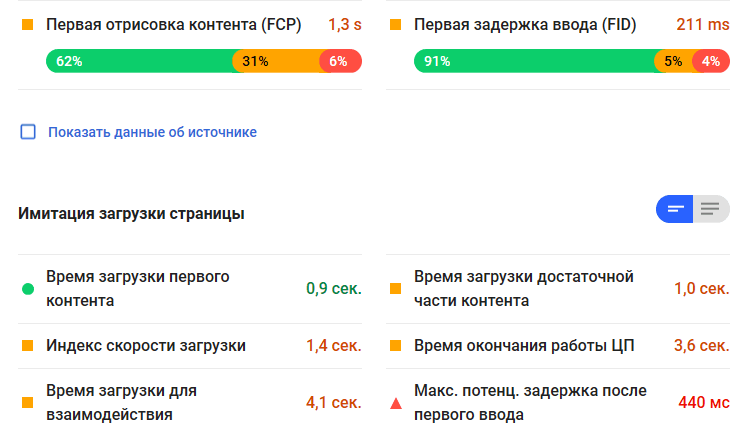

Согласно справке Google оптимальный показатель скорости загрузки — 200 мс до загрузки начального байта. Нужно стремиться к такому показателю, ведь долгая загрузка страниц влияет на лояльность посетителей и ранжирование в поисковых системах. Вся страница должна загружаться за 2-3 секунды, советуют в Google:

FCP — появление первого контента на странице;

FID — первая задержка между запросом браузера и ответом сервера.

Узнать скорость загрузки страниц можно в WebPageTest или подобных сервисах. Показатель скорости и рекомендации по его улучшению доступны в сервисе Google Page Speed.

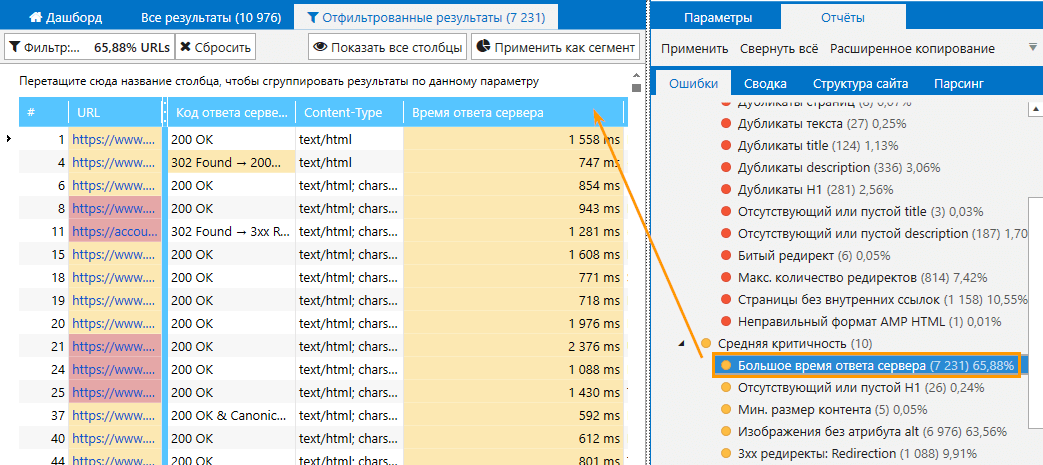

Чтобы получить список страниц сайта, скорость загрузки которых не соответствует норме, просканируйте сайт в Netpeak Spider и посмотрите отчёт по ошибкам.

2.8. Структура сайта

Структура сайта нужна для удобного перемещения пользвателей между страницами и разделами сайта и поиска нужных страниц. Она бывает линейной, разветвленной, древовидной или сетевой.

Чтобы выделить смысловую структуру сайта, составьте семантическое ядро. После его сбора будет проще распределить запросы по смыслу, сгруппировать их по разделам, категориям, страницам. Логичная структура сайта помогает посетителям ориентироваться в разделах сайта, а также участвует в распределении ссылочного веса. У сайта с правильной структурой больше шансов попасть на первые позиции в поисковой выдаче.

Для сканирования структуры ссылок используйте карту XML Sitemap. Во избежание индексирования административных разделов, закройте их в robots.txt через директиву disallow.

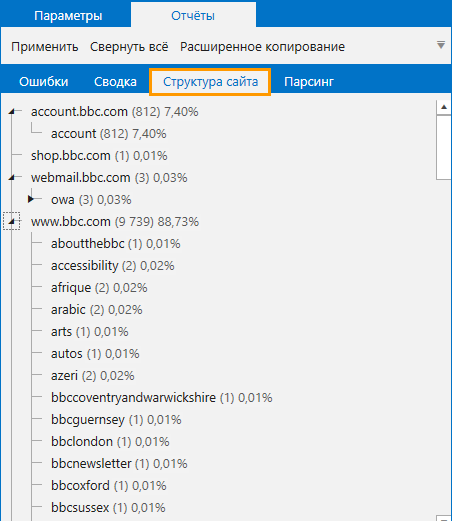

Чтобы посмотреть структуру сайта и выявить ошибки иерархии, просканируйте сайт в Netpeak Spider и откройте раздел с соответствующим названием

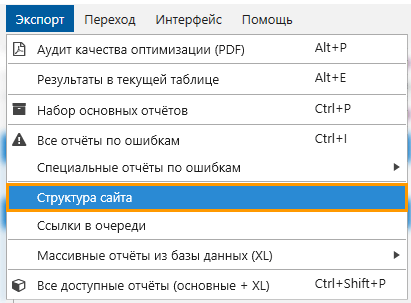

Также можно экспортировать структуру из программы:

2.9. Внутренняя перелинковка

Внутренняя перелинковка — это связь между страницами одного сайта. Перелинковка нужна, чтобы:

- увеличить статический вес страниц;

- повысить релевантность веб-страниц (при применении ключевых слов в анкорах);

- ускорение индексации страниц, которые находятся на большом уровне вложенности;

- пользователям проще было находить другие страницы и материалы внутри сайта.

Вот главные правила, которые помогут сделать внутреннюю перелинковку:

- структура сайта должна быть грамотно построена;

- распределять вес внутри сайта необходимо так, чтобы на продвигаемые страницы вели страницы с высоким уровнем авторитетности;

- старайтесь каждую страницу сайта перелинковать минимум с одной другой страницей;

- внутреннии ссылки не должны быть закрыты атрибутом rel=nofollow, так как они не будут передавать ссылочный вес.

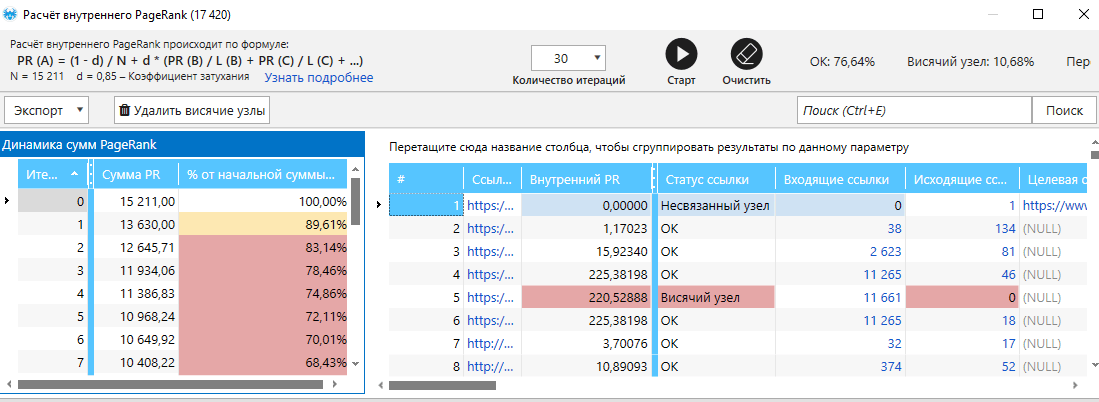

Чтобы узнать, какой вес получают страницы сайта, а также найти страницы, у которых нет связи с другими страницами, воспользуйтесь инструментом «Расчёт внутреннего PageRank» в Netpeak Spider.

- Отметьте перед сканирование параметры на боковой панели в разделе «Ссылки».

- Просканируйте сайт, затем перейдите в меню «Инструменты» и выберите «Внутренний PageRank».

- Здесь вы увидите таблицу с информацией по страницам: о весе, кодах ответа сервера, количестве исходящих и входящих ссылок.

- В отчётах по ошибкам в основном окне программы посмотрите, найдены ли ошибки «PageRank: отсутствуют связи» и «PageRank: отсутствуют исходящие ссылки».

2.10. Протоколы HTTP / HTTPS

Сайты с защищённым протоколом HTTPS обеспечивает повышенную безопасность для посетителей. Особенно это важно, если на сайте необходимо вводить персональные данные. При незашифрованном соединении эта информация может легко попасть в руки злоумышленников.

Сайты с незащищённым протоколом не могут смело претендовать на высокие позиции в поисковой выдаче. Для эффективного продвижения зарегистрируйте SSL-сертификат через официального представителя одного из центров аттестации. Чаще в роли таких представителей выступают хостинг-провайдеры.

2.11. ЧПУ

Человекопонятные URL — ссылки, состоящие из читабельных и понятных слов, например: example.com/tovary/igrushki.

Рекомендуется в URL-адресах использовать только латиницу, так как другие символы и буквы при копировании и вставке будут кодироваться:

Преобразовать URL можно при помощи онлайн-генераторов, плагинов CMS, правок в .htaccess или коде сайта.

Для автоматического формирования ЧПУ на сайтах WordPress можно использовать плагин RusToLat.

2.12. Глубина и вложенность URL

Глубина страницы — это количество кликов, которые совершает пользователь от главной до целевой страницы. Вложенность URL — это количество слешей в самом URL-адресе, например, здесь — example.com/tovary/igrushki — уровень вложенности равен двум.

Старайтесь максимально сокращать глубину страниц и вложенность URL, так как

- Поисковые системы быстрее индексируют страницы с минимальной глубиной чем те, которые находятся далеко от главной;

- Чем меньше уровень вложенности страниц (не URL),больше она получит вес

- Посетителям легче добраться до страниц, которые находятся на глубине меньше 5.

Идеально, если главная страница ссылается на все категории сайта, а категории — на целевые страницы.

Если сайт большой, и в нём есть подкатегории и фильтры, страницы пагинации и прочее, можно все важные подкатегории вынести сверху, а другие — вниз страницы. Ещё один вариант сократить вложенность страниц — создать и разместить HTML-карту сайта.

Подробнее мы рассказали в посте «Как создать HTML-карту сайта с помощью Netpeak Spider».

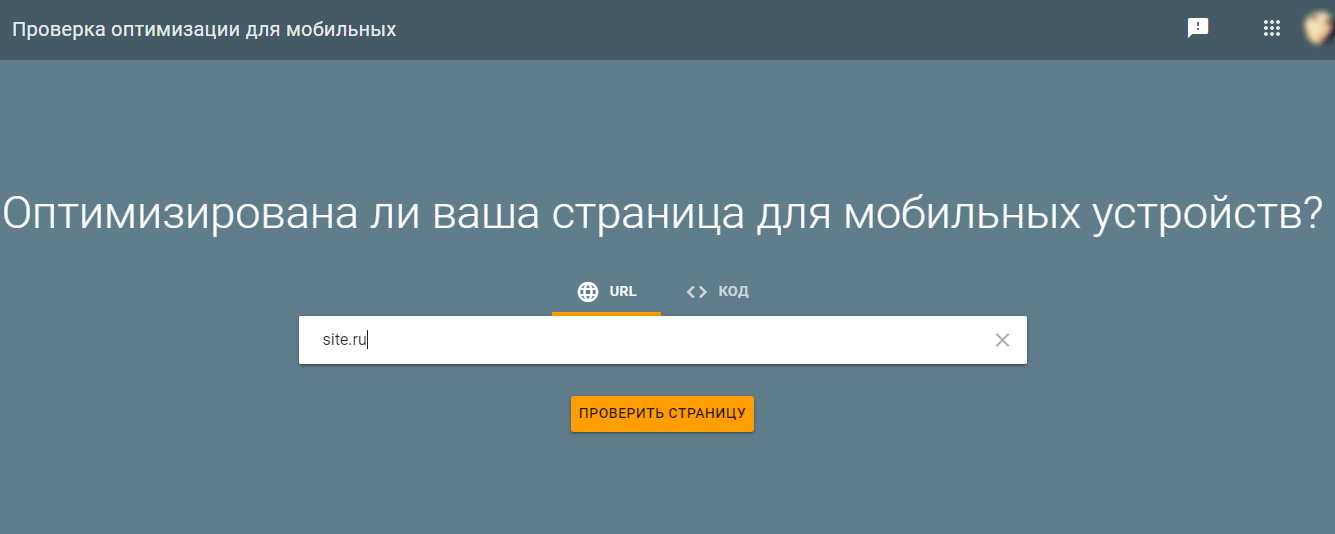

2.13. Оптимизация для мобильных устройств

В 2020 году каждый сайт должен быть полностью оптимизирован под мобильные устройства. Большинство интернет-аудитории используют мобильные, этот показатель очень важен для поисковой оптимизации. Также важно регулярно проверять сайт на правильность отображения для мобильных устройств. Проверить оптимизацию для мобильных можно в сервисе Mobile-Friendly от Google. Добавьте домен и запустите проверку.

2.14. Канонические страницы

Я уже упоминала в предыдущих пунктах, что канонические адреса страниц помогают устранить дубли на сайте. Так каноничность необходимо использовать для:

- страниц пагинации;

Подробнее: «Что такое пагинация, и как её оптимизировать».

- страниц фильтрации;

- мобильных версий сайта и/ или AMP-страниц;

- страниц с UTM-метками.

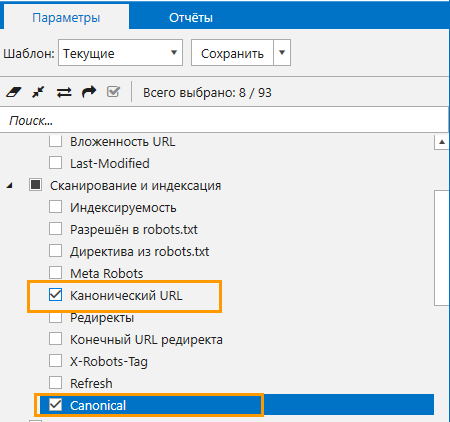

Чтобы проверить сайт на канонические ошибки, запустите Netpeak Spider. Программа находит следующие проблемы, связанные с rel="canonical":

- Неиндексируемый канонический URL → показывает страницы, которые содержат ссылку на закрытый от индексации URL.

- Цепочка канонический URL → определяет страницы, которыет начинают цепочку канонических станик либо в ней участвуют.

- Неканонические страницы → находит страницы, у которых URL а теге rel="canonical" или HTTP-заголовке указывает на другую страницу.

- Одинаковые канонические URL → показывает страницы с одинаковыми каноническими URL в тегах rel="canonical" или в HTTP-заголовке.

Для поиска ошибок проделайте следующее:

- Убедитесь, что в параметрах на боковой панели проставлены галочки рядом с пунктами «Канонический URL» и «Canonical».

- Поставьте сайт на сканирование.

- Найденные канонические ошибки программа покажет в отчёте по ошибкам.

2.15. Оптимизация контента

Как правило, оптимизация контента включает:

- Анализ и подбор ключевых слов. Чтобы ваш контент ранжировался в поисковой выдаче по релевантным запросам, необходимо подобрать ключевые слова. Это можно с делать с помощью специальных сервисов, таких как Serpstat, Планировщик ключевых слов от Google и других. Детально о работе с ключевиками в посте «Как эффективно искать и анализировать ключевые слова».

- Структурирование текста. Подразумевается наличие заголовков H1-H6, списков (нумерованных и маркированных).

- Составление метаданных. Title и description формируют сниппет в результатах выдачи. Создавайте информативные, краткие и привлекательные заголовок и описание, а также добавляйте в них ключевые слова, но без переспама.

- Работа над уникальностью текстов.

2.16. Оптимизация изображений

Оптимизация картинок помогает привлекать дополнительный трафик (из поиска по картинкам), а также позитивно влияют на поведенческие факторы.

Как оптимизировать изображения:

- Прописывайте теги alt (точное и краткое описание) для каждой картинки. Используйте ключевые слова, если это уместно.

- Сжимайте изображения, чтобы они не перегружали страницу и не препятствовали быстрой скорости загрузки.

- Не используйте изображения, которые защищены авторским правом.

- Старайтесь возле изображения размещать релевантный ему текст.

Подводим итоги

Технический SEO анализ нужно регулярно проводить для каждого сайта. В этом посте я описала основные аспекты, которые важно брат во внимание, чтобы сделать сайт удобным и приятным для пользователя, а также улучшить его ранжирование в поисковых системах.

Расскажите, а как вы проводите техническую оптимизацию своего сайта? Буду рада вашим комментариями и рекомендациям.